Red Teaming LLM: методика тестирования бота на prompt injection и утечки данных

Практическое руководство по тестированию AI-ботов на безопасность. Как организовать red team сессии, какие атаки проверять, примеры prompt injection и защита от утечек данных. Опыт казахстанских компаний.

Читать далее

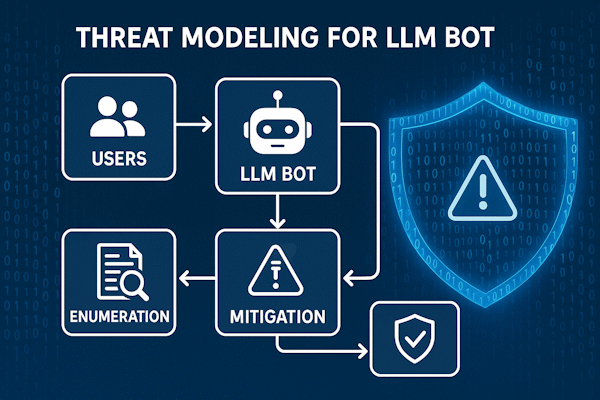

Threat modeling для LLM‑бота: 12 угроз и как закрывать их архитектурно

Практическая модель угроз для CRM‑бота: prompt injection, data exfiltration, PII leakage. Разбираем реальные сценарии атак, даем чеклист защиты и baseline архитектуры, чтобы вы могли спать спокойно.

Читать далее